2025年11月18日,全球知名CDN与网络安全服务商Cloudflare遭遇了一场持续超3小时的大规模故障。此次事件导致全球大量网站、API服务及企业内部系统瘫痪,引发行业广泛关注。故障平息后,Cloudflare官方发布详细事故报告,揭露了这起由内部配置变更触发、经多重系统链路放大的"蝴蝶效应"事件全貌。

一、故障核心背景与时间线

1. 故障关键时间节点(北京时间)

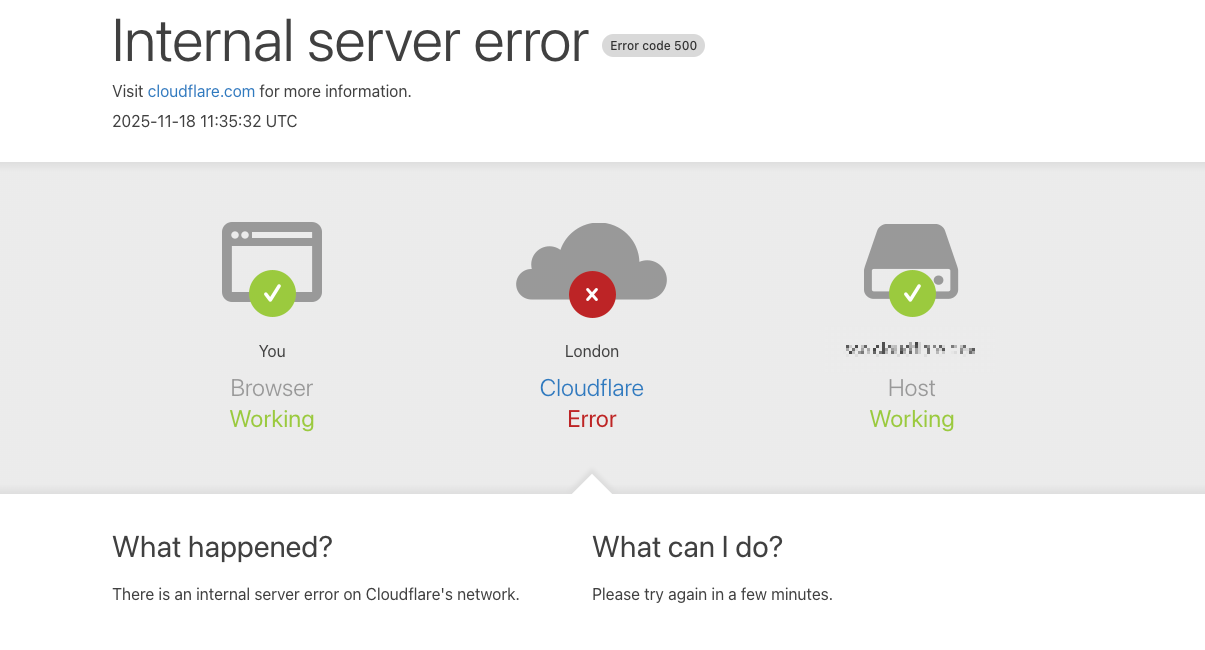

- 11月18日19:28:故障正式爆发,用户访问开始出现大量500错误

- 11月18日22:30:核心服务逐步恢复,错误率显著下降

- 11月19日01:06:所有依赖服务完全重启,系统恢复正常运行

- 总影响时长:约3.5小时,覆盖全球主要地区的业务高峰期

2. 事件定性

此次故障并非外部攻击(如DDoS攻击)导致,而是内部数据库权限优化操作引发的连锁反应。本质是"人为操作疏漏+系统设计缺陷"叠加造成的技术事故,暴露了复杂分布式系统中微小变更可能引发的致命风险。

二、故障根源:从权限调整到全球崩溃的完整链路

1. 初始操作:数据库权限优化

UTC时间11月18日11:05,Cloudflare工程师对ClickHouse数据库集群执行了一项权限优化操作。该操作的初衷是提升查询权限控制的精细化程度,让用户能够查看自身有权访问的所有数据表元数据,属于常规性系统改进。

Cloudflare此次故障再次印证了"千里之堤,溃于蚁穴"的道理--一条未写全的SQL查询、一个缺乏容错的硬编码限制,在复杂分布式系统的放大效应下,最终引发了全球范围的服务雪崩。对于所有技术团队而言,此次事件的启示在于:系统可靠性的构建不在于某个环节的极致优化,而在于每个细节的严谨把控,以及面对异常时的容错能力。

无论是大型科技企业还是中小型团队,都应从此次故障中吸取教训:重视配置变更的风险评估、完善系统的容错设计、建立全链路的监控体系。唯有如此,才能在复杂多变的技术环境中,最大限度地避免类似的"蝴蝶效应",保障服务的稳定运行。

官方报告:https://blog.cloudflare.com/18-november-2025-outage

原创文章,更多AI科技内容,微信搜索 橙市播客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明