最近刷到一篇讨论AI Agent的帖子,看完后脑子里嗡嗡的,很多以前零散的困惑突然连成了一条线。作者Akshay把核心讲得很透:现在大家动不动就把Agent搞砸,其实不是模型不够聪明,而是我们没给它搭好“马具”(Harness)。

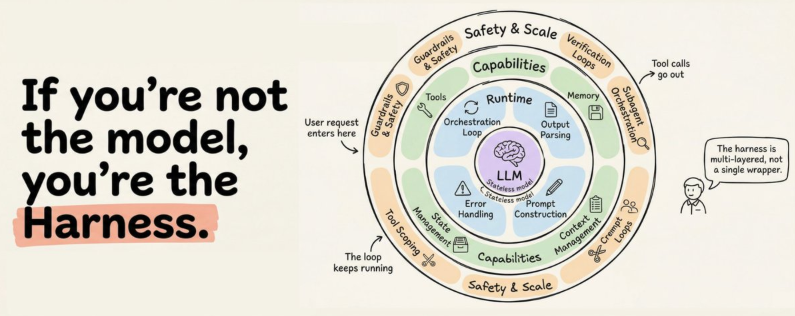

简单说,LLM就像一颗裸CPU,它有计算能力,但没有内存管理、没有持久化存储、没有可靠的I/O接口。你直接扔给它一个复杂任务,它转两圈就迷路了。Harness就是那个把CPU变成真正计算机的操作系统--它负责工具调用、状态保持、错误恢复、上下文调度……所有让Agent能长期稳定工作的底层工程。

一句话总结:如果你不是模型本身,那你就得是Harness。

从“提示工程”到“马具工程”

我们对AI的理解其实经历了三个阶段。

最早是Prompt Engineering,大家拼命琢磨怎么写提示词。后面发现光写得好还不够,得管好模型“看到什么、何时看到”,于是有了Context Engineering。而真正的生产级Agent,远远超出这两者,它需要一套完整的Harness Engineering--把提示、上下文、工具、状态、安全、验证全部串起来,形成一个能自我运转的闭环系统。

LangChain团队有个观点我特别认同:Agent的智能是涌现出来的,而Harness才是把这种涌现变成可靠产品的工程体系。同一模型,不同Harness,表现能差十万八千里。

举个实际例子:LangChain在某个TerminalBench测试里,靠改进基础设施(没换模型),排名从30名开外直接冲到第5。还有项目让LLM自己去优化Harness,结果通过率达到了76.4%。这说明,瓶颈往往不在模型,而在支撑它的那套系统。

一个靠谱Agent Harness到底需要什么?

真正拉开差距的,从来不是谁用了最新的模型,而是谁把模型之外的这些基础设施做得更扎实、更聪明。

AI Agent的时代才刚开始。模型会越来越强,但懂Harness的人,会一直有饭吃。

更多AI科技内容,微信搜索橙市播客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明