OpenClaw 是一个开源的本地自主 AI 代理项目,它能通过你常用的聊天工具(如 WhatsApp、Telegram、Slack 等)与你对话,并帮你处理邮件、日历、浏览器操作等各种实际任务。作为一个完全本地运行的“个人 AI 助理”,它最大的优势在于隐私和可控性,但也因此继承了大多数长上下文代理的经典问题:当对话积累到一定长度后,默认的内存机制会进行 compaction(上下文压缩/截断),导致代理“忘记”早期的重要信息。

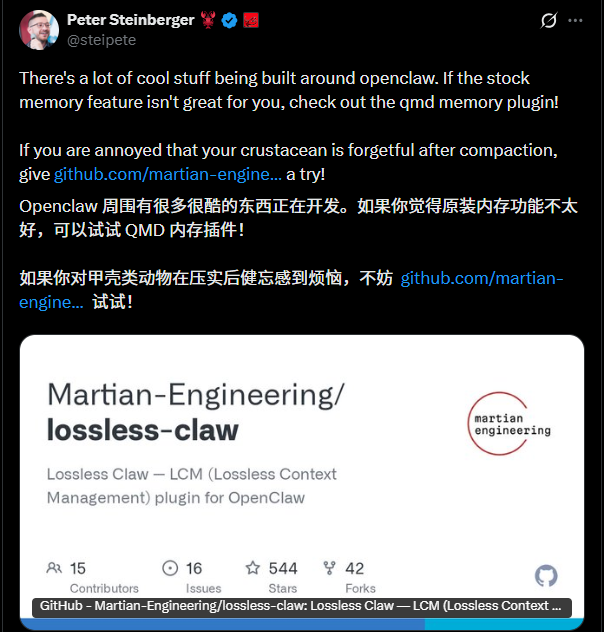

OpenClaw 的创始人 Peter Steinberger 今天在推特上公开推荐了一个社区插件,来解决这个让很多用户抓狂的“蟹容易忘事”问题。他直言:如果默认内存功能对你来说不够好,不妨试试这个--lossless-claw。

什么是 lossless-claw?

lossless-claw(全称 Lossless Claw - LCM,即 Lossless Context Management)是由 Martian-Engineering 团队开发的一个 OpenClaw 插件,灵感来源于 LCM 论文。它彻底替换了 OpenClaw 原生的滑动窗口压缩机制,转而采用一套基于 DAG(有向无环图)的分层摘要系统,实现真正的“永不遗忘”。

核心思路非常优雅:

- 所有消息永久保存:每一条用户和代理的消息都会被完整存入本地的 SQLite 数据库(默认路径

~/.openclaw/lcm.db),绝不丢弃任何原始内容。 - 分层摘要 + DAG 结构:系统用 LLM 把旧消息分块生成摘要,形成树状(DAG)结构:

- 最底层(leaf 节点):对小批次消息(例如每 8 条)的精炼摘要;

- 更高层(condensed 节点):对多组 leaf 摘要再做进一步压缩。

- 动态上下文组装:每次生成回复时,插件会智能挑选相关摘要 + 最近的原始消息,塞进模型的上下文窗口,既保持信息完整,又不会超 token 限制。

- 代理可主动“找回”细节:插件为代理提供了几个强大工具:

lcm_grep:像 grep 一样全文搜索历史;lcm_describe:描述某个历史片段;lcm_expand:展开某个摘要节点,恢复原始内容。

这样一来,你的“蟹”不仅不会随便忘事,还能像人类一样“想起来再细查”,极大提升长周期任务的可靠性和连贯性。

为什么会推荐第三方插件?

Peter 在帖子中提到:“周围正在构建很多很酷的东西。如果默认内存对你来说不够好,试试 qmd memory plugin!如果 compaction 后你的 crustacean 容易忘事,那就试试 lossless-claw。”

项目地址:https://github.com/martian-engineering/lossless-claw

OpenClaw 主仓库:https://github.com/openclaw/openclaw

🦞 让你的 Claw 拥有永不失忆的超级记忆体吧!

原创文章,更多OpenClaw养龙虾教程,微信搜索橙市播 客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明