你可能已经习惯了这样的场景:

给 ChatGPT 一段资料

让它总结、分析、再回答问题

它看起来表现得非常聪明

于是我们下意识地以为:

大模型已经学会了“从上下文中学习”。

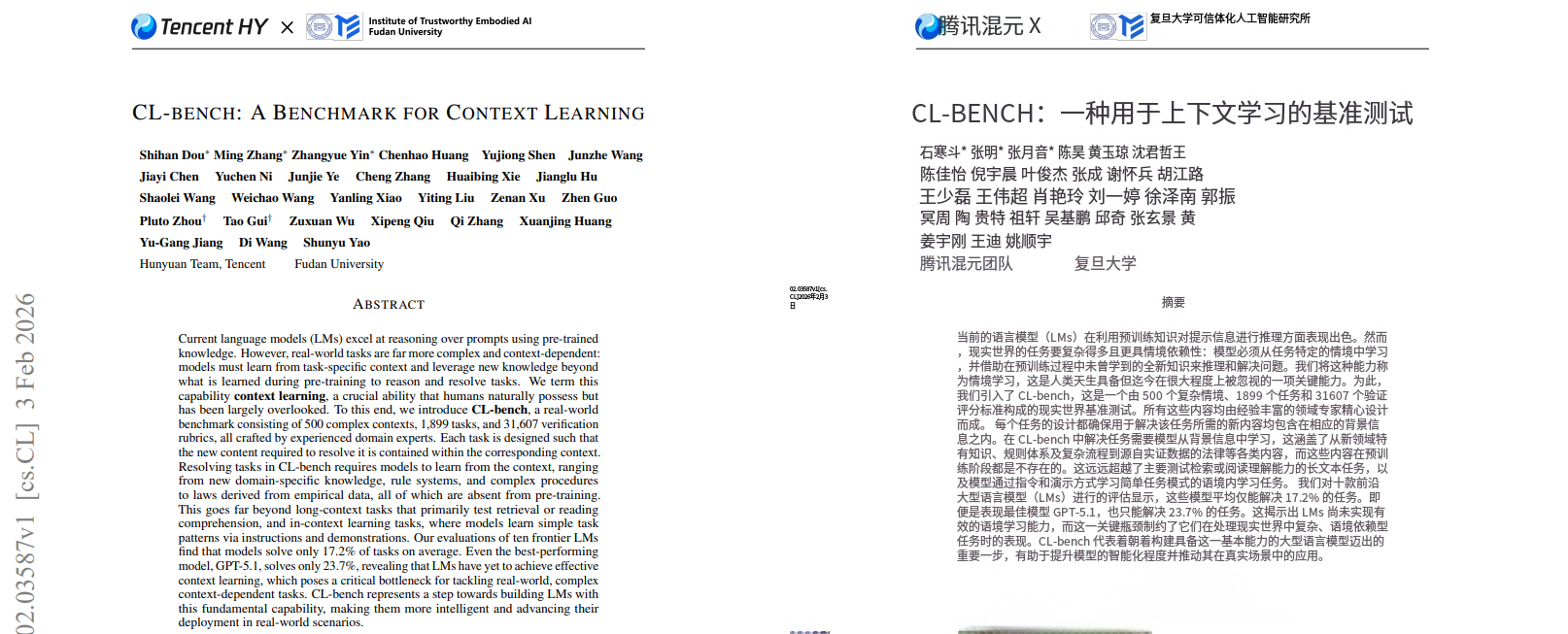

但 2026 年 2 月,一篇论文《CL-BENCH: A BENCHMARK FOR CONTEXT LEARNING》直接给这个认知泼了一盆冷水。

结论只有一句话:

当任务真的需要“从上下文中学习新知识”时, 目前所有主流大模型,几乎全线翻车。

部分内容已折叠,查看完整文章请先登录。 登录后查看完整文章

真正的“从上下文中学习”, 现在仍然是开放难题。

论文地址:https://arxiv.org/pdf/2602.03587

项目主页:clbench.com

原创文章,更多AI科技、提示词内容,微信搜索橙市播客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明