过去十年,深度神经网络创造了一个又一个奇迹:语言理解、图像生成、机器人控制、药物研发……但它们仍然有一个令人不安的共同点:像黑箱一样难以理解。

为什么模型会得出某个结论? 为什么它突然出错? 我们怎么知道它是否在“欺骗”我们?

这些问题关系到 AI 的安全、监管、信任,也关系到它是否能真正进入医疗、金融、自动驾驶等高风险领域。

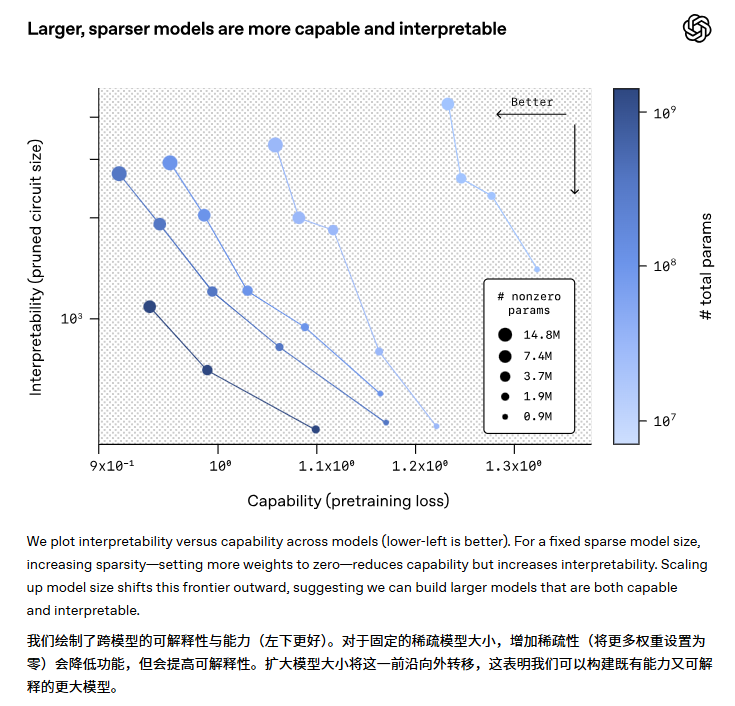

最近,OpenAI 发布了一项重要研究方向: 通过训练“稀疏电路(Sparse Circuits)”的方式,从根本上让神经网络变得更透明、更容易被人类理解。

一、为什么可解释性会成为 AI 的核心战场?

随着强模型逐渐用于医疗辅助、法律推理、机器人控制等重要场景,我们必须知道两件最基本的事情:

- 模型为什么这么做?

- 模型有没有隐藏的危险行为?

OpenAI 把可解释性视为安全的关键一环。它并不取代对抗训练、监督、红队测试等安全手段,但它能提供一种底层级别的透明度--像是给大脑“做脑部核磁共振”。

部分内容已折叠,查看完整文章请先登录。 登录后查看完整文章

- AI 正在从工具走向自主系统

- 人类必须从现在开始建立透明、可解释的基础设施

- “稀疏电路”是第一批能让我们从底层理解 AI 的真实技术

随着 OpenAI 和研究社区继续推进这种方向,我们离“可读懂的智能系统”越来越近。

未来的 AI,不应该是黑箱,而应该是电路板。

原创文章,更多AI科技、提示词内容,微信搜索橙市播客 小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明