前几天刷到NVIDIA机器人团队负责人Jim Fan在Sequoia AI Ascent上的演讲视频《Robotics: Endgame》,20分钟看完后我直接把链接转发给了几个做机器人和AI的朋友,说这是最近看到的最带劲的一场分享。

Jim Fan去年讲过《Physical Turing Test》,今年直接把续集端上来了。他整场演讲的核心就一句话:大语言模型走通的那条路,机器人也能抄,而且已经抄到关键节点了。

从LLM的“endgame”说起

演讲开头他讲了个小故事。2016年在OpenAI,他和Jensen Huang、Elon Musk一起给一台DGX-1签名。那时候大家还觉得GPU主要是玩游戏和做科学计算,谁能想到今天AI全靠它起家。Jim Fan借Ilya那句名言-“如果你相信deep learning,它就会相信你”-切入正题。

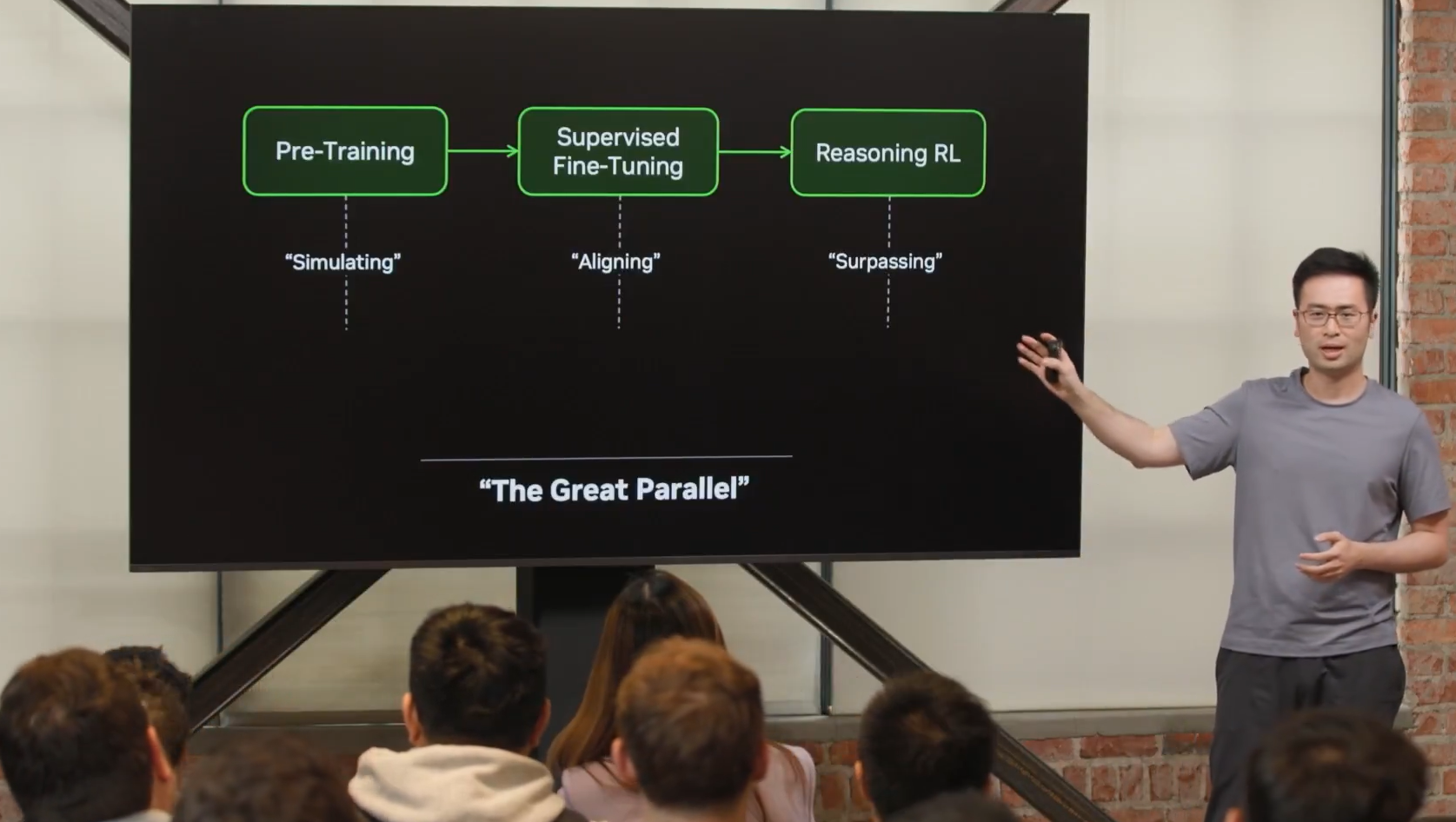

LLM这几年走的路,大家都看在眼里:海量预训练 → 对齐微调 → 推理增强 → 自动研究。短短几年就把“语言智能”卷到了今天这个地步。Jim Fan说,他看着LLM的进展,心里其实挺“嫉妒”的,因为机器人领域一直没这么顺。

但他认为,机器人可以走完全一样的路,只是把“下一个token”换成了“下一个物理世界状态”。这就是他反复强调的“The Great Parallel”--伟大平行。

VLA已经不够用了

过去几年,Vision-Language-Action模型(VLA)是主流。大家把视觉、语言、动作塞进一个大模型里,看起来很全能。但Jim Fan直言:它还差得远。

VLA里语言参数占比太高,擅长记名词、知识、指令,却不太懂真正的物理“动词”。比如它能把可乐罐准确放到Taylor Swift的海报上(因为见过很多类似场景),但在真正复杂的物理交互上表现一般。语言在拖后腿。

链接在这里(原推特帖子):https://x.com/DrJimFan/status/2052758642781487237

你觉得机器人真正普及还需要多久?欢迎评论区聊聊。

更多AI科技内容,微信搜索橙市播客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明