引言

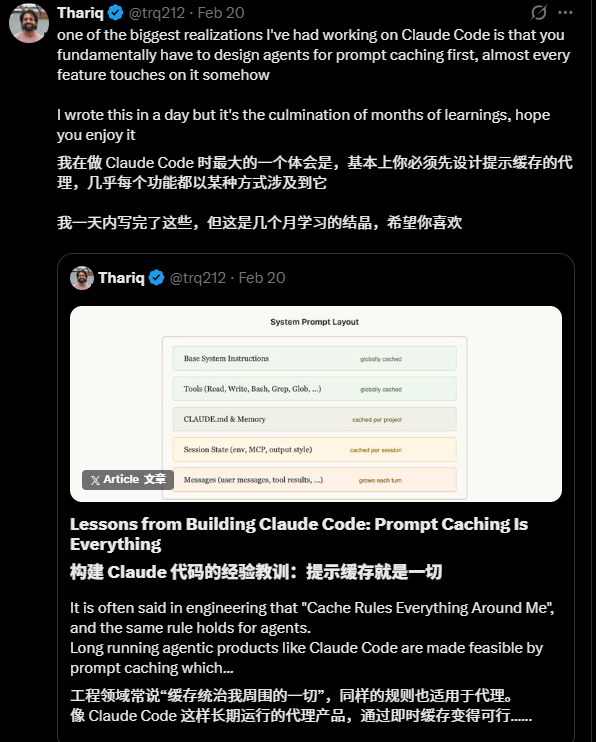

在人工智能飞速发展的今天,尤其是 AI 编程工具的开发领域,效率与优化已经成为核心竞争力。Anthropic Claude Code 团队成员Thariq在 X 平台发布了一篇极具洞见的帖子,标题为《Lessons from Building Claude Code: Prompt Caching Is Everything》(构建 Claude Code 的经验教训:Prompt Caching 就是一切)。这篇文章迅速在 AI 开发者社区引发热烈反响。

Thariq 将工程界经典口号“Cache Rules Everything Around Me”(缓存统治一切,源自 Wu-Tang Clan 的“C.R.E.A.M.”)引入 AI 领域,强调 Claude API 中的 Prompt Caching(提示缓存)功能已成为构建可扩展、低成本 AI 代理系统(Agentic Systems)的关键支柱。

本文会系统讲解 Prompt Caching 的工作原理、从 Claude Code 实际开发中提炼的五条核心规则、代理式编码与非编码系统的设计对比,以及对 AI 开发者的深远启示。无论你是个人开发者还是企业级 AI 方案架构师,这些经验都能帮助你将 API 调用成本降低高达 90%、延迟降低 85%,同时充分发挥大语言模型的全部潜力。

理解 Prompt Caching:高效 AI 代理的基础

Prompt Caching 的核心思想是让 Claude API 缓存并复用之前请求中的中间计算结果。它基于前缀匹配(prefix matching)机制:如果新提示的前缀与已缓存的内容完全一致,系统就会直接复用存储的键值(KV)缓存和哈希,避免重复计算 token。

这对代理式系统尤为重要,因为这类系统通常涉及:

- 超长提示

- 工具调用

- 多轮对话

- 上下文记忆

- 重复出现的固定指令

关键机制要点:

对于正在使用 Claude API 的开发者来说,现在就是开始一次彻底的“提示缓存审计”的最佳时机。你的钱包、你的用户、你的系统性能,都会因此受益匪浅。

原贴地址:https://x.com/trq212/status/2024574133011673516?s=20

原创文章,更多AI科技内容,微信搜索橙市播客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明