DeepSeek联合清北发布的论文 《DualPath: Breaking the Storage Bandwidth Bottleneck in Agentic LLM Inference》。这篇论文没有讨论更大的模型、更多的参数,而是聚焦一个常被忽视但越来越关键的问题:

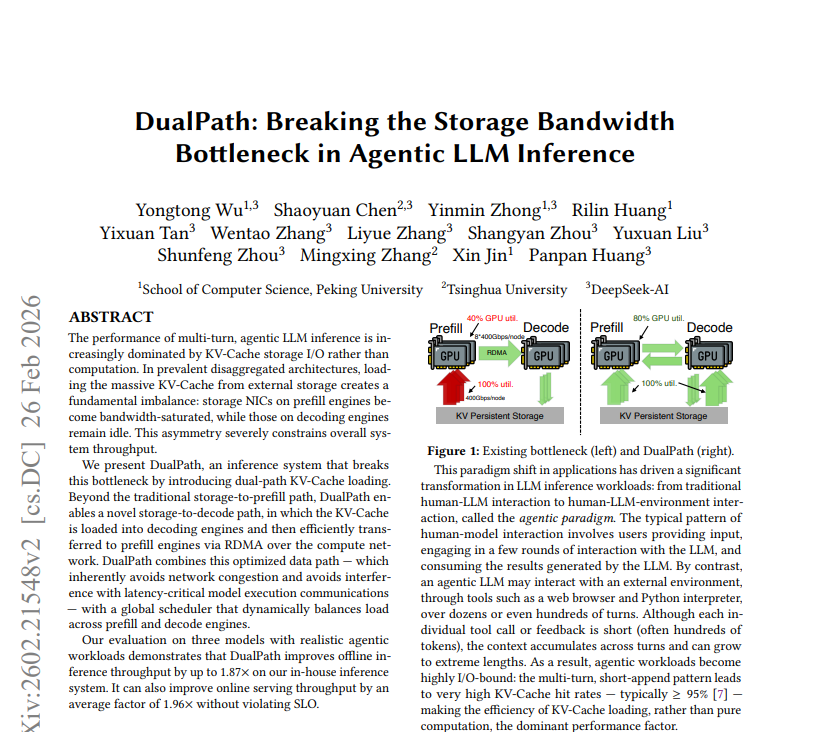

当大模型进入“智能体时代”,真正拖慢系统的,已经不是算力,而是数据搬运。

一、从“算力瓶颈”到“带宽瓶颈”

在传统大模型推理场景中,瓶颈通常是:

- GPU 算力不够

- 计算太慢

- 模型太大

但智能体(Agentic LLM)场景不一样。

智能体推理的典型特征:

- 多轮交互

- 长上下文记忆

- 高频 KV-Cache 复用

- 每轮生成 token 很少

部分内容已折叠,查看完整文章请先登录。 登录后查看完整文章

这可能只是一个开始。 未来的 Agent 基础设施之战,很可能不再发生在模型层,而是发生在“数据流动方式”上。

论文地址:https://arxiv.org/pdf/2602.21548

更多AI科技内容,微信搜索橙市播客小程序

微信扫描下方的二维码阅读更多精彩内容

声明:本站所有文章,如无特殊说明或标注,均为橙市播客原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。如果你是AI总结,务必加上此版权说明